在金融科技領域,用戶畫像系統(tǒng)是精準營銷、風險控制和產(chǎn)品優(yōu)化的核心引擎。面對海量、多源、高并發(fā)的數(shù)據(jù)流,如何實現(xiàn)實時、準確、高效的用戶畫像計算,成為企業(yè)技術能力的重要體現(xiàn)。友信金服作為行業(yè)領先的金融科技公司,其日處理數(shù)據(jù)量超過10億條,通過基于Apache Flink構建的實時用戶畫像系統(tǒng),成功解決了這一挑戰(zhàn)。本文將深入解析其實踐路徑與技術架構。

一、 業(yè)務挑戰(zhàn)與架構選型

友信金服原有的批處理畫像系統(tǒng)存在明顯的延遲問題,無法滿足實時風控、秒級營銷推薦等場景的需求。主要挑戰(zhàn)包括:

- 數(shù)據(jù)規(guī)模巨大:日處理數(shù)據(jù)量超過10億條,涵蓋用戶行為、交易、設備、外部數(shù)據(jù)源等。

- 實時性要求高:部分業(yè)務場景(如反欺詐、實時授信)需要在毫秒到秒級內完成用戶標簽的更新與查詢。

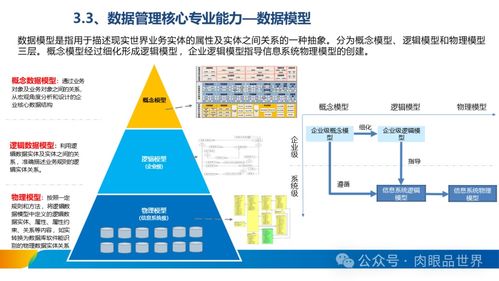

- 計算邏輯復雜:用戶標簽涉及多維度統(tǒng)計、模型預測、規(guī)則引擎等多種計算模式。

- 系統(tǒng)需要高可用與可擴展:業(yè)務快速增長,系統(tǒng)需能彈性伸縮,并保證7x24小時穩(wěn)定運行。

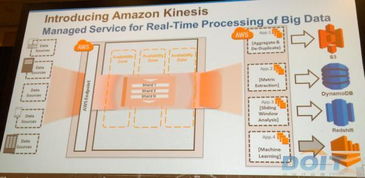

經(jīng)過綜合評估,Apache Flink因其出色的流處理能力、精確的狀態(tài)管理和成熟的生態(tài)系統(tǒng)被選為核心計算引擎。Flink的“流批一體”理念,特別是其對事件時間、狀態(tài)管理和Exactly-Once語義的強大支持,非常適合構建低延遲、高一致性的實時用戶畫像系統(tǒng)。

二、 系統(tǒng)核心架構設計

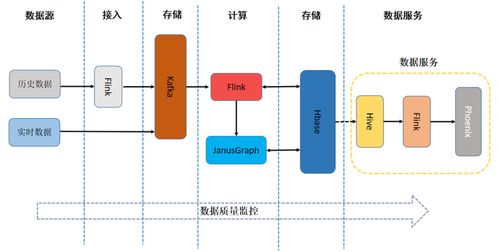

友信金服的實時用戶畫像系統(tǒng)采用分層架構,確保數(shù)據(jù)從接入到服務的高效流轉:

1. 數(shù)據(jù)采集與接入層:

- 通過自研的Agent、日志收集系統(tǒng)以及對接Kafka等消息隊列,將來自APP、網(wǎng)站、第三方合作方的用戶行為、交易流水等數(shù)據(jù)實時接入。

- 數(shù)據(jù)經(jīng)過格式標準化和初步過濾后,統(tǒng)一發(fā)送到核心的Kafka集群,作為整個實時數(shù)據(jù)流的唯一入口。

2. 實時計算層(Flink為核心):

- 流式ETL作業(yè):多個Flink作業(yè)并行消費Kafka數(shù)據(jù),進行數(shù)據(jù)清洗、補全、格式轉換,并輸出到下游。

- 標簽計算作業(yè):這是系統(tǒng)的核心。根據(jù)標簽的計算邏輯(如統(tǒng)計型、規(guī)則型、模型預測型),設計不同的Flink作業(yè):

- 統(tǒng)計型標簽(如“近1小時點擊次數(shù)”):利用Flink的滑動/滾動窗口、Keyed State進行聚合計算。

- 規(guī)則型標簽(如“是否符合某營銷活動條件”):集成規(guī)則引擎(如Drools),在數(shù)據(jù)流中動態(tài)匹配規(guī)則。

- 模型預測型標簽(如“信用評分”):將實時特征通過Flink的異步IO或與特征平臺對接,調用線上機器學習模型服務獲取預測結果。

- 所有計算出的標簽更新事件,會實時寫入在線存儲(如HBase、Redis)和離線數(shù)倉(如Hive)做備份與歷史分析。

3. 存儲與服務層:

- 在線存儲:選用HBase作為主存儲,以用戶ID為RowKey,支持海量標簽數(shù)據(jù)的高并發(fā)、低延遲隨機讀寫。熱點標簽(如實時授信用標簽)會緩存在Redis集群中,提供亞毫秒級查詢。

- 標簽服務:構建統(tǒng)一的標簽查詢API服務,對內提供毫秒級的標簽查詢與組合查詢能力。服務層集成了緩存、降級、限流等機制保障高可用。

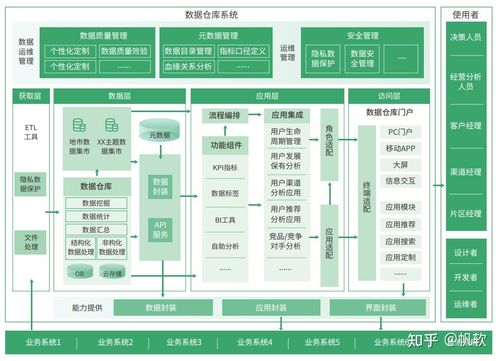

4. 管理與監(jiān)控層:

- 開發(fā)了標簽管理平臺,用于標簽定義、血緣追溯、生命周期管理和數(shù)據(jù)質量監(jiān)控。

- 通過Flink Metrics、Prometheus和Grafana對作業(yè)延遲、吞吐量、背壓、資源使用率進行全方位監(jiān)控與告警。

三、 關鍵技術實踐與優(yōu)化

- 狀態(tài)管理與容錯:

- 充分利用Flink的RocksDB狀態(tài)后端,將用戶粒度的中間計算狀態(tài)(如計數(shù)、列表)可靠存儲,支持作業(yè)失敗后快速恢復。

- 精細設置狀態(tài)TTL,自動清理過期用戶數(shù)據(jù),控制狀態(tài)規(guī)模。

- 數(shù)據(jù)傾斜處理:

- 對于“明星用戶”等導致的數(shù)據(jù)傾斜問題,采用“本地聚合+全局聚合”的兩階段聚合方法,或在Key前添加隨機前綴進行打散,優(yōu)化計算資源利用。

- 維表關聯(lián)優(yōu)化:

- 頻繁變化的維度數(shù)據(jù)(如產(chǎn)品信息)通過Flink Async I/O進行關聯(lián),并利用Guava Cache或Caffeine做本地緩存,減少對外部數(shù)據(jù)庫的查詢壓力。

- 資源彈性與部署:

- 基于YARN或K8s進行Flink集群部署,根據(jù)業(yè)務流量峰谷動態(tài)調整作業(yè)并行度與集群資源,實現(xiàn)成本與效率的平衡。

四、 實踐成效與未來展望

通過引入Flink構建實時用戶畫像系統(tǒng),友信金服取得了顯著成效:

- 實時性飛躍:用戶行為觸發(fā)后,相關標簽可在秒級內更新并用于決策,相比T+1的批處理模式有質的提升。

- 支撐核心業(yè)務:系統(tǒng)有效支撐了實時反欺詐、精準營銷投放、個性化推薦、動態(tài)額度管理等關鍵業(yè)務場景,提升了業(yè)務轉化率和風險控制水平。

- 系統(tǒng)穩(wěn)定高效:系統(tǒng)日均處理超10億事件,核心接口P99延遲控制在50毫秒以內,并平穩(wěn)應對了多次業(yè)務高峰挑戰(zhàn)。

友信金服計劃在以下方向繼續(xù)深化:

- 向流批一體架構演進:更深入利用Flink SQL和Table API,統(tǒng)一實時與離線標簽的開發(fā)與管理體驗。

- 強化特征工程平臺:將實時特征計算能力平臺化、標準化,賦能更多AI場景。

- 探索動態(tài)更新模型:研究如何在實時數(shù)據(jù)流中嵌入在線學習,實現(xiàn)用戶畫像模型的動態(tài)實時演進。

###

友信金服的實踐表明,基于Apache Flink構建的實時用戶畫像系統(tǒng),是處理海量數(shù)據(jù)、滿足金融級實時性要求的有效方案。它不僅解決了傳統(tǒng)批處理的延遲瓶頸,更以流式計算的思維方式重塑了數(shù)據(jù)驅動的業(yè)務流程。這一成功實踐為金融科技乃至其他數(shù)據(jù)密集型行業(yè)構建實時智能數(shù)據(jù)系統(tǒng)提供了寶貴參考。技術的價值在于賦能業(yè)務,而一個穩(wěn)定、高效、敏捷的實時數(shù)據(jù)處理服務,正是金融科技企業(yè)實現(xiàn)智能化升級的關鍵基石。